BY 媒介360

一个简单好用的图生视频工具应该长什么样?最近,阿里云科研智算团队给出了他们的答案:高保真+高可控性。

Animate Anything是阿里云科研智算团队从去年7月就着手研究的图生视频项目。当时,虽然已经有不少文生图领域的公司如Midjourney、Stability AI等走红,但图生视频领域的研究都还非常少,更别说有成熟可用的模型了。

Animate Anything的开发团队就开始探索通过什么技术让图片动起来既精准、又连贯。

以往AI生成视频的一个常见问题是精细度受损——图片在生成视频的过程中,常常容易出现原图被扭曲变形的问题,尤其是在人物面部特征和皮肤纹理这些细节上,导致生成视频很容易就有“一眼假”人工感,甚至在几秒内就让人“改头换面”。

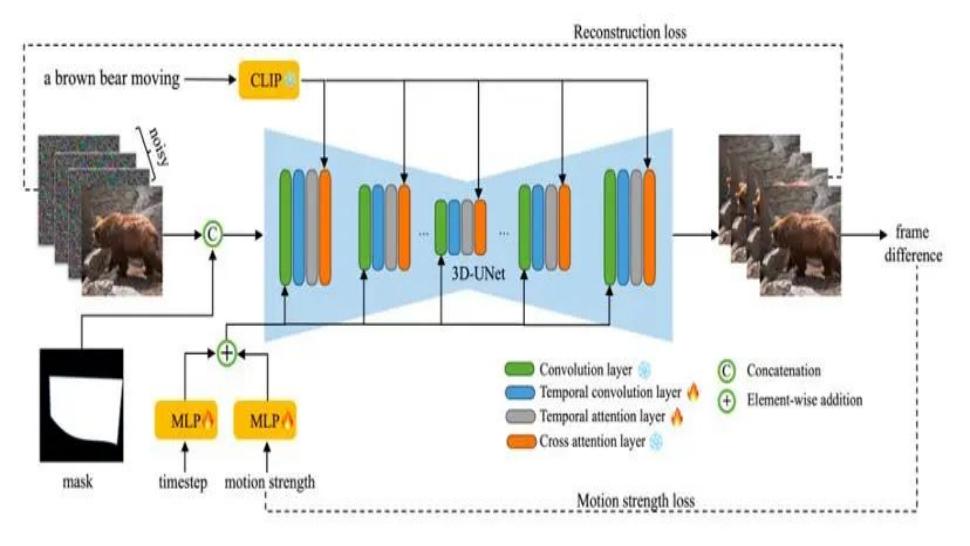

但是,Animate Anything通过技术手段提高了生成视频对原图像的保真度。团队在阿里VideoComposer模型的基础上做了微调,清理过滤了千万量级HD- VILA-100M数据集,从中挑选出了20万个视频片段。在训练过程中,算法工程师通过保留每一个视频的第一帧,往剩下帧上加入噪声的方法,让网络学习并预测出完整视频。这种方式让图片在“动”起来的同时,还能对原图的画面保持较高的还原度。

可控性的提高也提升了生成视频的良品率。也就是说,以往用户可能需要生成10个视频,才有1个符合要求。但现在,用户可以在两三次尝试后就得到一个满意的视频,这有助于用户体验感的提升。

Animate Anything是阿里云科研智算团队从去年7月就着手研究的图生视频项目。当时,虽然已经有不少文生图领域的公司如Midjourney、Stability AI等走红,但图生视频领域的研究都还非常少,更别说有成熟可用的模型了。

Animate Anything的开发团队就开始探索通过什么技术让图片动起来既精准、又连贯。

以往AI生成视频的一个常见问题是精细度受损——图片在生成视频的过程中,常常容易出现原图被扭曲变形的问题,尤其是在人物面部特征和皮肤纹理这些细节上,导致生成视频很容易就有“一眼假”人工感,甚至在几秒内就让人“改头换面”。

但是,Animate Anything通过技术手段提高了生成视频对原图像的保真度。团队在阿里VideoComposer模型的基础上做了微调,清理过滤了千万量级HD- VILA-100M数据集,从中挑选出了20万个视频片段。在训练过程中,算法工程师通过保留每一个视频的第一帧,往剩下帧上加入噪声的方法,让网络学习并预测出完整视频。这种方式让图片在“动”起来的同时,还能对原图的画面保持较高的还原度。

可控性的提高也提升了生成视频的良品率。也就是说,以往用户可能需要生成10个视频,才有1个符合要求。但现在,用户可以在两三次尝试后就得到一个满意的视频,这有助于用户体验感的提升。