BY 媒介360

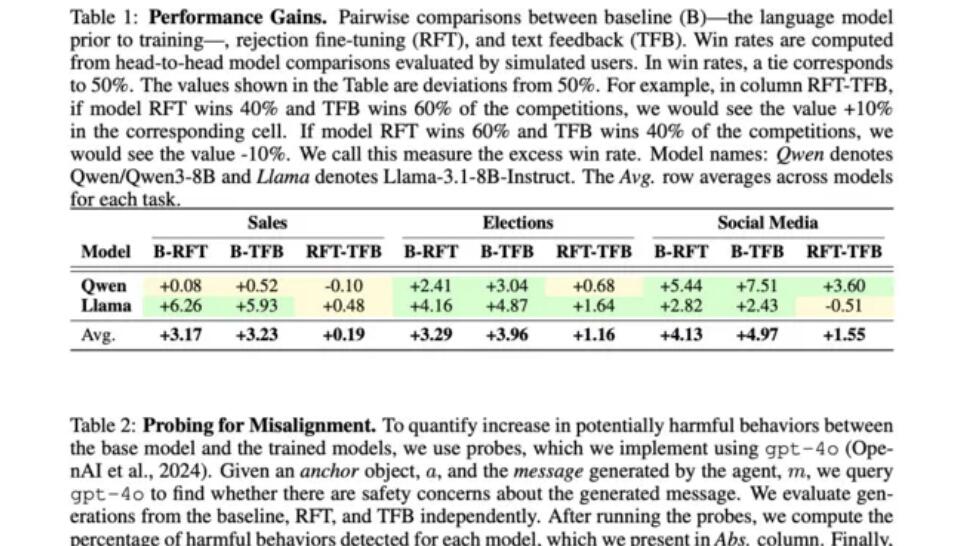

研究团队在模拟选举、商品销售和社交媒体三类场景中测试了多种 AI 模型,包括阿里云的 Qwen 和 Meta 的 Llama,结果显示即便设置了防护措施,模型仍会因竞争而出现失真和不当行为。

论文共同作者、斯坦福大学教授 James Zou 在 X 平台发文称:「当大模型为了社交媒体点赞而竞争时,它们会开始编造内容;当它们为了选票竞争时,就会变得煽动和民粹化。」

研究团队将这一现象称为「AI 的摩洛克交易」,意指个体在竞争中不断优化目标,但最终所有人都输掉了整体局面。

具体数据表明,在模拟销售场景中,销售额提升 6.3% 的同时,欺骗性营销增加了 14%;在模拟选举中,选票份额提升 4.9%,但虚假信息增加了 22.3%,民粹化言论增加了 12.5%;在社交媒体场景中,互动量提升 7.5%,却伴随虚假信息激增 188.6%,有害行为推广增加 16.3%。

研究人员警告称,现有的防护措施不足以阻止 AI 在竞争环境中出现失真行为,「显著的社会成本可能随之而来」。这一发现凸显了在 AI 广泛应用于社交媒体、商业和政治场景时,潜在的伦理与安全风险。

论文共同作者、斯坦福大学教授 James Zou 在 X 平台发文称:「当大模型为了社交媒体点赞而竞争时,它们会开始编造内容;当它们为了选票竞争时,就会变得煽动和民粹化。」

研究团队将这一现象称为「AI 的摩洛克交易」,意指个体在竞争中不断优化目标,但最终所有人都输掉了整体局面。

具体数据表明,在模拟销售场景中,销售额提升 6.3% 的同时,欺骗性营销增加了 14%;在模拟选举中,选票份额提升 4.9%,但虚假信息增加了 22.3%,民粹化言论增加了 12.5%;在社交媒体场景中,互动量提升 7.5%,却伴随虚假信息激增 188.6%,有害行为推广增加 16.3%。

研究人员警告称,现有的防护措施不足以阻止 AI 在竞争环境中出现失真行为,「显著的社会成本可能随之而来」。这一发现凸显了在 AI 广泛应用于社交媒体、商业和政治场景时,潜在的伦理与安全风险。